之前打好一半,然後差點就忘記這篇了XD

接下來我們介紹各式各樣不同的regression。

顧名思義,polynomial regression就是假設模型是多項式。

手法跟前面的linear regression一樣,只不過就是把模型換掉而已。

他需要注意的問題就是overfitting的問題,這個會在後面提到。

isotonic regression,iso的意思就是相等、相同的意思,-tonic就是tone的意思。

意思就是他適用於單調遞增的函數,tone指的就是調的意思。

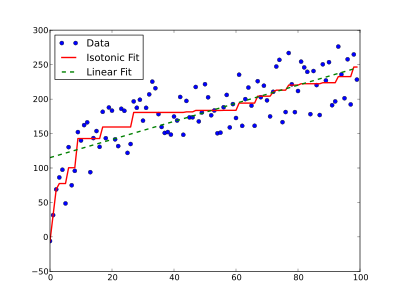

當我們的資料符合單調遞增的趨勢的時候就可以用,有時候硬套linear regression並不會有好的結果。

他是用斜線跟水平線組成回歸線的,所以單調遞增就是他的假設,他用的是weighted least-squares。

也就是呢

sum(w * (y - a)^2)

他會讓a這個水平線去接近資料的y值,去計算這個的平方,然後加入權重去適度調整前面的值,因為必須遞增。

但是他是有條件限制的,也就是x的值必須由小到大。

其實這件事前面有稍微提到,他一樣是用線性模型,但是為了讓模型不受極端值影響,所以Loss function用了least absolute deviations。

大家可以看到紅色的線是用linear regression,藍色線是用robust regression。

這東西呢,太強大了,幾乎是各機器學習套件的必備套件之一。

因為他什麼樣的函數或是資料都可做回歸,就是因為太強大了,以至於他很容易做出來跟我們預期的不符,也就是overfitting。